Llama3-7B

登录上财人工智能平台

登录上财教学网https://bb.sufe.edu.cn,选择“算力与实验”--“人工智能平台”进入平台

选择GPU服务申请,自动跳转到gemini平台

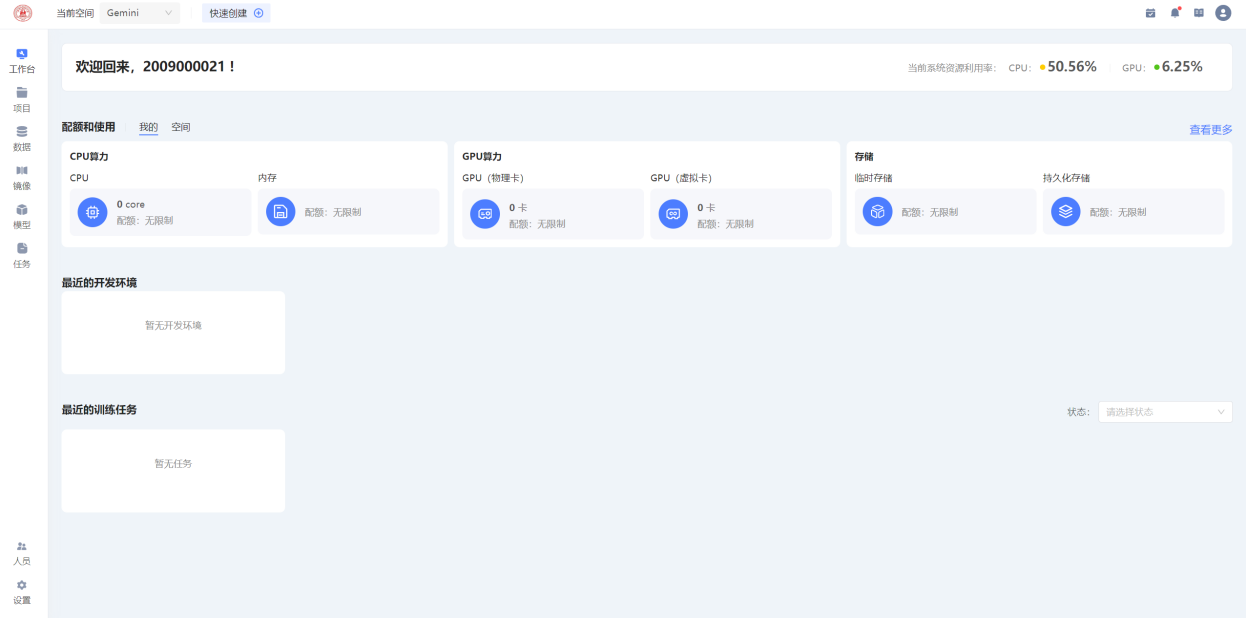

查看自己的可用资源配额

首次登录设置自己的SSH登录密码,方便以后使用,设置一次即可

创建项目

创建Llama3-7B的演示环境

代码仓库信息:

https://github.com/meta-llama/llama3

分支:main

镜像选择:公开镜像study:lama3-8b-chat

数据挂载:公开数据集 Atom-7B-Chat

初始化开发环境

项目创建完成后,运行代码,进行环境初始化

环境选择虚拟GPU,配置如下

ssh设置: 开启,可以用开始配置的ssh密码登录环境

开发工具:JupyterLab

进入开发环境

环境初始化提交后,等待平台进行资源分配,当环境变成运行中,表示环境完成启动

拉取llama3的项目代码

cd /gemini/code/

git clone https://github.com/LlamaFamily/Llama-Chinese.git

进入开发环境,执行

启动llama3基于web的对话程序

cd /gemini/code/Llama-Chinese

python examples/chat_gradio.py --model_name_or_path /gemini/data-1/Atom-7B-Chat

web页面访问需要基于外部端口进行访问,映射内部端口7860到外部。

注意:每个人的IP和端口是不同的,根据自己的环境来修改